简介:Seedance 1.5 的下一步是什么?

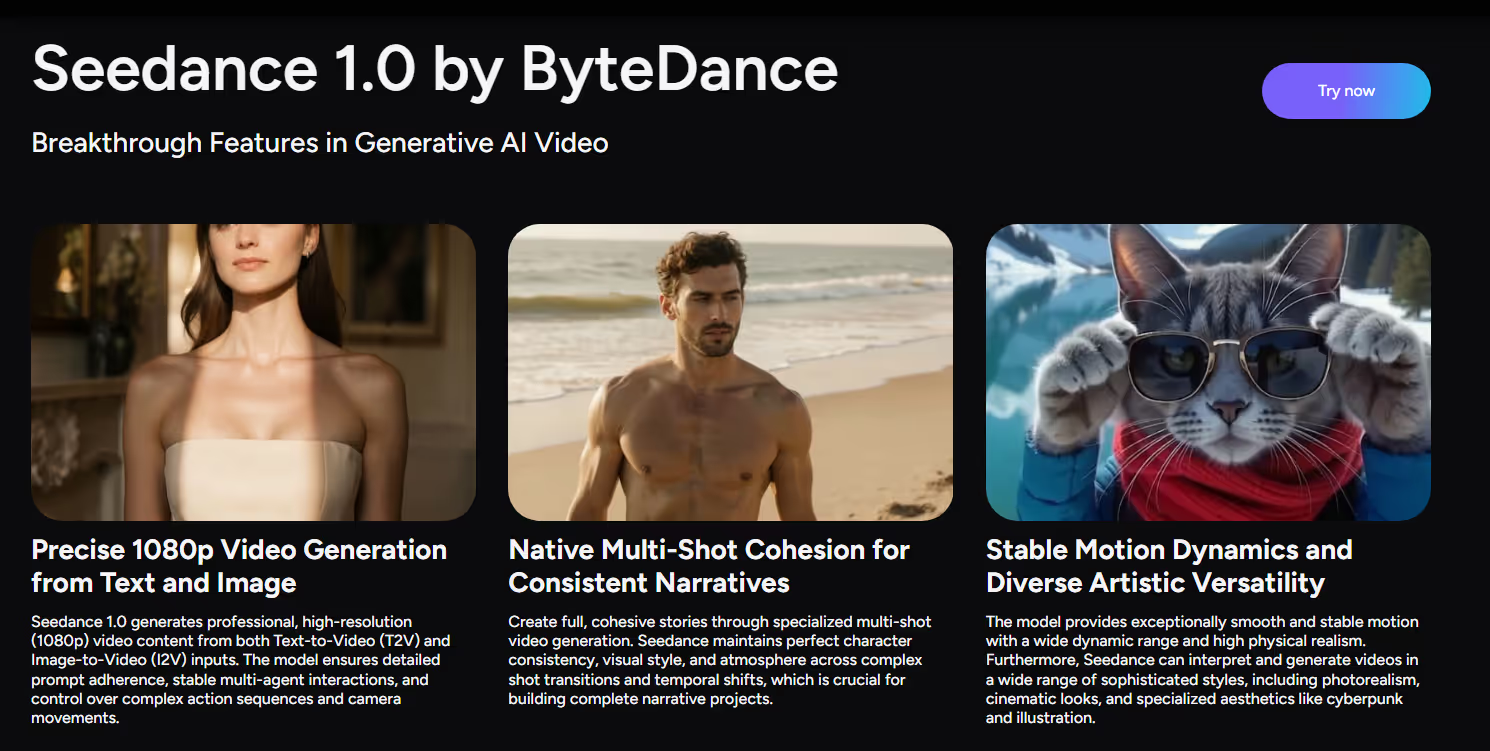

Seedance 已迅速成为美国最受关注的名字之一 AI 视频生成。当前的 Seedance 1.0 系列已经支持 多镜头视频 通过文本和图像输入,提供动作流畅、语义理解深刻和快速关注的 1080p 片段。简而言之,今天的 Seedance 是一款快速、高质量的 AI 视频生成器 专为电影短篇故事讲述而打造。

该系列的下一个演变尚未正式发布,但基于Seedance现有的技术报告和视频基础模型的更广泛方向,可以合理地预计,即将到来的 Seedance 1.5 AI 视频模型 将不仅仅是更长、更流畅的片段。对于创作者来说,两个特别令人兴奋的领域可能是:

- 音视频同步 — 一起生成视频和声音

- 视频参考 — 使用现有镜头来指导动作、风格或连续性

在本预览中,我们将探讨创作者对下一代Seedance的期望:以当今的Seedance功能为起点,预测的关键功能和实际用例。

创作者可以期待什么(预测)

重要:以下功能是预测性的,是从当前的 Seedance 1.0 文档和行业趋势中推断出来的。它们尚未正式宣布。

1。更长、更连贯的多镜头叙事

Seedance 1.0 已经脱颖而出了 多镜头叙事连贯性,具有无缝过渡效果,镜头中的拍摄对象保持一致。

即将推出的模型很可能:

- 支持 更长的多镜头序列 比当前 5s—10 秒的默认值

- 提高时间稳定性,减少扩展片段的闪烁

- 在多个剪辑和场景中保持更清晰的故事流程

对于创作者来说,这意味着在单个小故事、多场景广告和简短的叙事曲线中留出更多空间 AI 视频生成 通过。

2。更智能的文字转视频和图像到视频的控制

今天的 Seedance 支持两者 文字转视频 (T2V) 和 图像到视频 (I2V),允许创作者根据提示或静止图像对场景进行动画处理,最高可达 1080p。

下一个模型可能会通过以下方式增强这一点:

- 更好的处理能力 复杂的多步提示 (“三枪:广阔的城市景观,然后是特写角色,然后是产品英雄”)

- 更精确 相机语言 控制:特写、追踪镜头、手持镜头、慢速变焦

- 更紧密地整合 图像参考 用于样式、布局和角色控制

这将使下一期 Seedance 版本更具表现力 文字转视频 AI 和 图像到视频的人工智能 适用于希望将书面说明直接映射到摄像机动作和构图的创作者。

3.音视频同步(预计)

下一个Seedance模型的一个主要前沿可能是个主要前沿领域 音视频同步。

Seedance 1.0 已经解决了视觉挑战——多镜头连贯性、稳定的动作和快速渲染——但它输出的是无声片段。根据其他基础模型的趋势,合乎逻辑的下一步是 AI 视频模型 这可以生成:

- 口语旁白或对话

- 环境音景(街道噪音、自然、室内)

- 音效与屏幕上的事件保持一致

- 简单的音乐或同色床

所有 已同步到视频 一次性完成。

如果音视频同步出现在下一个Seedance版本中,创作者可以:

- 使用内置声音生成适合社交的视频,而不是单独编辑音频

- 使用 AI 旁白和动作制作讲解员风格的片段

- 原型故事创意,让节奏、视觉和声音共同演变

这会让 Seedance 从沉默中消失 AI 视频生成器 变成一个更完整的 AI 视频创作 系统。

4。动作和风格的视频参考(预计)

另一个可能的升级是 视频参考 支持:能够向模型提供简短的参考视频,让它们指导新片段的动作、风格或结构。

基于Seedance在多镜头叙事和图像指导方面的现有优势,视频参考可以让创作者:

- 使用实景片段作为摄像机移动和计时的模板

- 将动作模式(例如行走周期、镜头平移或动作节拍)传输到新生成的场景中

- 在 AI 生成的多个序列变体中保持一致的取景和节奏

对于 AI 视频生成,视频参考将成为在传统镜头和完全合成内容之间架起桥梁的强大工具,尤其有助于构思、预览和风格实验。

5。更快、更高效的 AI 视频生成

Seedance的技术报告显示,由于多阶段蒸馏和系统级优化,速度比许多竞争对手高出约10倍。

可以合理地期望下一个模型:

- 保持或改善这一点 高速推理

- 提供对质量与速度的更多控制(例如,“快速草稿” 与 “电影渲染”)

- 支持更高的批量并发度 AI 视频生成器 工作负载

对于创作者和团队来说,这可以在更短的时间内转化为更多的迭代——非常适合测试挂钩、故事变化或视觉指导。

创作者如何使用 Next Seedance 1.5 模型

一旦下一款Seedance模型推出这些预期的升级,这些功能将如何转化为现实世界 AI 视频创作 工作流程。

1。 社交和活动视频 带有内置声音

根据预期 音视频同步,创作者可以使用 Seedance 来:

- 生成 Tiktok/Reels/Shorts 内容,让视觉效果和声音融为一体

- 制作宣传短片,将产品镜头、动作和音频提示对齐

- 无需完整编辑通行证即可快速测试不同的叙事和音频组合

这使得 文字转视频 AI 为平台上的声音提供更多的 “发布就绪”。

2。视频参考驱动的动作和风格

如果 视频参考 受支持,下一个Seedance模型可能非常适合:

- 模仿参考广告或预告片的节奏和镜头动作

- 将粗略的故事板或试拍照片翻译成经过精心设计的 AI 生成的版本

- 在更改风格、设置或角色时保持动作和时间一致

对于创作者来说,它在手动拍摄和全合成之间架起了桥梁 Seedance AI 视频,支持混合工作流程。

3. 多镜头故事板 和概念预告片

凭借更长、更连贯的多镜头叙事和更强的 T2V/I2V 控制,Seedance 可以提供帮助:

- 将脚本片段变成快速的视频故事板

- 为产品、游戏或电影制作概念预告片

- 为相同的故事节拍探索不同的视觉风格

这降低了在投入全面制作之前通过视觉方式探索复杂想法的障碍。

4。适用于演示和讲解员的图像到视频动画

使用增强版 图像到视频的人工智能 还有可能的音频同步,下一个Seedance模型将非常适合:

- 将产品渲染动画制作成带旁白的讲解片段

- 通过引导式摄像机移动和点击流将用户界面模型变为现实

- 使用同步的声音提示将角色艺术转化为动作测试

这些工作流程可帮助团队快速从静态设计转向动态演示。

结论

下一代 Seedance 1.5 人工智能视频 尚未正式发布,但路线图很容易从Seedance 1.0的优势中推断出来:电影般的1080p 文字转视频 和 图像到视频、多镜头叙事连贯性且快速、高效 AI 视频生成。

展望未来,创作者可以合理地预期:

- 更长、更连贯的多镜头故事

- 更智能的控制 关于提示、摄像机语言和视觉风格

- 音视频同步 用于原生声音、语音和效果(预期)

- 视频参考 从现有镜头中引导动作和风格(预计)

- 高速推理 这样可以保持快速的迭代周期

在我们等待官方宣布的同时,最好的准备工作是探索 Seedance 今天已经在做的事情:多镜头、电影般的 AI 视频创作 来自文字和图像。这样,您就可以准备好在下一代模型问世后立即将其纳入您的工作流程。

密切关注官方的 Seedance 和 Seedance 频道以获取发布更新,并准备好在新模型上线时尝试音频同步、以参考为导向的 Seedance AI 视频讲述故事。